¿Qué tan privados son tus chats con las IAG?

Las Inteligencias Artificiales Generativas (IAG) se han integrado profundamente en nuestras rutinas digitales. Desde asistentes personales hasta motores de creación de contenido, estos sistemas resuelven dudas y completan tareas creativas. Pero, al mismo tiempo, cada interacción deja una huella. ¿Qué pasa con los datos que compartimos al chatear con estas inteligencias? ¿Quién los ve? ¿Se usan para entrenar futuros modelos?

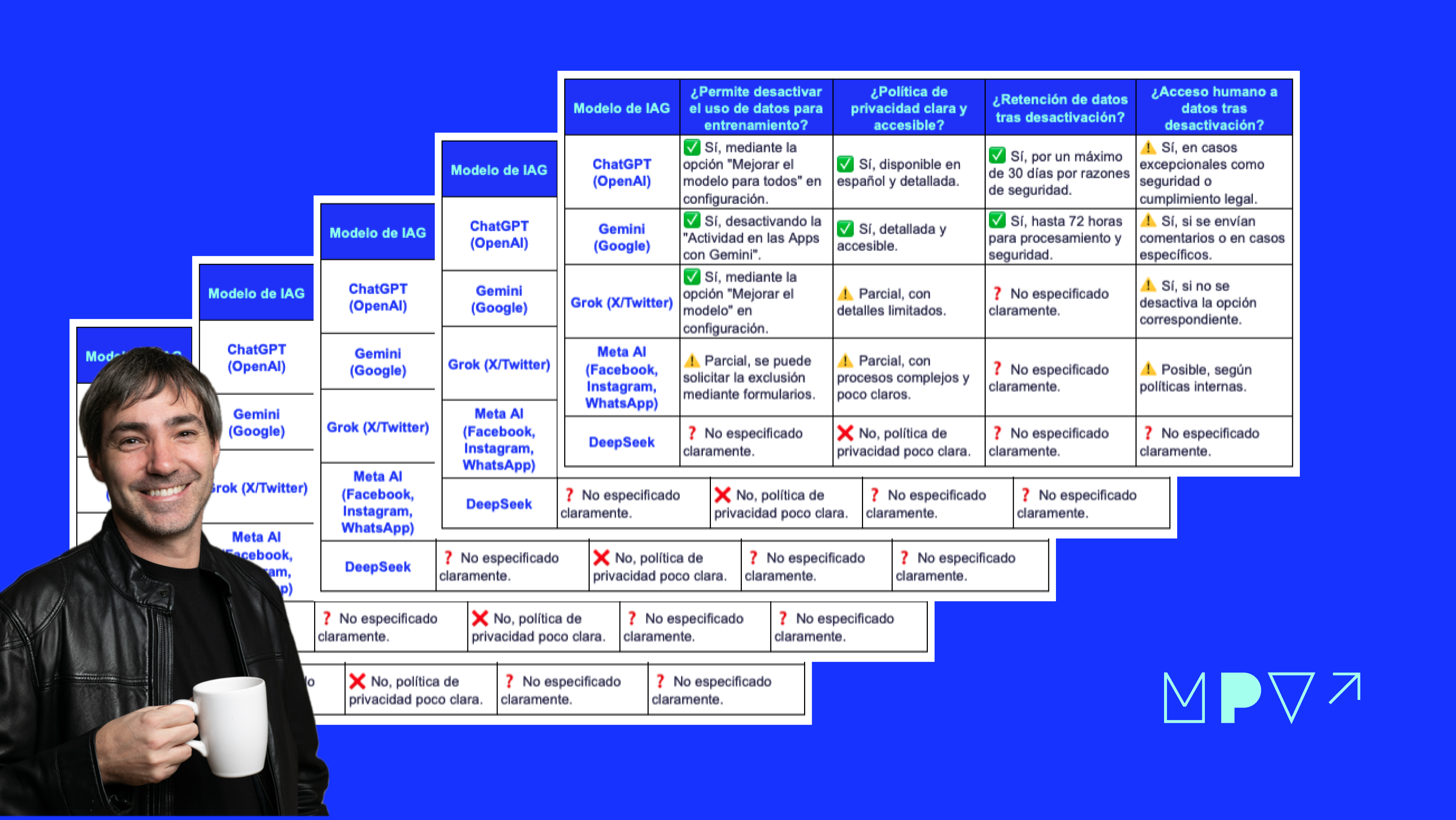

Para responder estas preguntas, realicé una comparación entre cinco de las principales plataformas de IAG: ChatGPT (OpenAI), Gemini (Google), Grok (X/Twitter), Meta AI (Facebook/Instagram) y DeepSeek.

Analicé cuatro aspectos que creo importantes que sepamos cuando interaccionamos con estos sistemas:

- ¿Se puede desactivar el uso de datos para entrenamiento?;

- ¿La política de privacidad es clara y accesible?;

- ¿Los datos se retienen después de la desactivación?; y

- ¿Puede haber acceso humano a las conversaciones?.

Lo primero que salta en el análisis es que no todas las plataformas permiten desactivar el entrenamiento con tus datos, y entre las que sí lo hacen, el alcance de esa desactivación varía. Por ejemplo, en ChatGPT podés desactivar la opción “Mejora el modelo para todos” desde la configuración. En Gemini, la opción está dentro de la configuración de actividad de cuenta. En cambio, Meta AI requiere completar un formulario manual para oponerse, y en DeepSeek ni siquiera hay información clara al respecto.

Otro aspecto importante es la retención de datos tras la desactivación. Aun cuando desactivás el uso de datos para entrenamiento, la mayoría de las plataformas siguen almacenando tus conversaciones temporalmente por razones técnicas, de seguridad o cumplimiento legal. Esto significa que, aunque tus datos no entrenen nuevos modelos, siguen existiendo en servidores por días o semanas. En casos excepcionales, empleados autorizados pueden acceder a ellos.

Consecuentemente, desactivar el entrenamiento no es sinónimo de privacidad total. La falta de estándares comunes, la opacidad de algunas políticas y la escasa educación digital del público hacen que muchos crean estar protegidos cuando en realidad siguen compartiendo información sensible sin saberlo. Por eso, es clave fomentar una ciudadanía digital informada que esté al tanto sobre el tema.

La metodología de Automatización Responsable permite desarrollar tecnologías con transparencia, dando a las personas herramientas claras para ejercer control sobre sus datos. Este cuadro comparativo es un aporte para visibilizar qué empresas realmente se esfuerzan en respetar esos principios, y cuáles no. Elegir tecnologías responsables también es un acto humano: defendamos nuestro derecho a saber qué se hace con nuestra data.